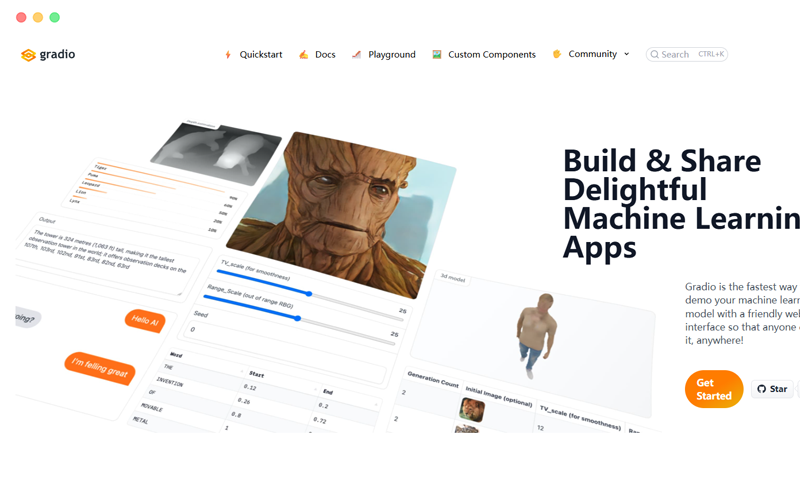

Gradio是一个面向机器学习和深度学习开发者的开源 Python 库,它最大的特点是“无需前端开发经验,也能快速构建可交互的界面”。这一特性降低了模型可视化的门槛,让模型不再局限于 Jupyter Notebook 或命令行输出,而是能以图形化的方式直观展现,并通过网页与用户进行交互。

Gradio 的本质定位

Gradio 的本质,是一个“快速搭建 AI 模型前端界面”的轻量级工具。它不依赖于复杂的前端框架,不需要用户掌握 HTML、CSS 或 JavaScript。用户只需要使用几行 Python 代码,指定输入输出的类型与逻辑,即可生成一个本地或在线可访问的交互页面。

简而言之,Gradio 解决了一个关键问题:如何将机器学习模型“包裹”成一个用户友好的应用界面。

它不像传统的 Web 开发框架(如 Flask、Django)那样追求全面性与灵活性,而是专注于一个点:**交互式模型展示。**正是这一聚焦,使得 Gradio 在短时间内迅速被广泛采用。

Gradio 的主要应用价值

Gradio 的核心价值在于其“快速构建 – 快速反馈 – 快速迭代”的开发理念,它为以下场景带来了显著的效率提升:

| 应用场景 | 说明 |

|---|---|

| 模型演示 | 研究者或工程师可快速构建一个演示界面,向非技术团队或客户展示模型效果。 |

| 用户反馈 | 用户可通过界面直接测试模型并反馈问题,有助于开发者调试与优化。 |

| 教学与培训 | 教师可以通过 Gradio 展示模型如何处理输入,帮助学生更直观地理解机器学习流程。 |

| 数据标注 | 将模型包装为“标注助手”,结合用户交互,提高数据预处理和标注效率。 |

| 多模态研究 | 利用 Gradio 同时处理图像、音频、文本等多种输入输出,适合跨模态研究任务的展示与验证。 |

Gradio 的使用门槛之低,让很多原本只能运行在本地 notebook 中的模型,迅速具备了“产品级界面”,极大拓展了其传播范围与受众体验。

技术背景与发展动力

Gradio 起初由两位机器学习从业者 Abubakar Abid 和 Dawood Khan 创建,目的是简化他们在实验中不断编写展示界面的重复性工作。他们敏锐地意识到:虽然训练一个模型可能只需几天时间,但要构建一个能让人理解、使用并反馈结果的界面,却可能耗费更多精力。

这一现实问题反映了机器学习在走向“应用”阶段时遇到的最大壁垒——缺乏易用的交互工具。Gradio 的出现,正是对这一需求的回应。它最初于 2019 年在 GitHub 上开源,很快获得了大量开发者的青睐。

在 2021 年,著名的 AI 社区 Hugging Face 收购了 Gradio 项目,并将其整合进 Hugging Face Hub。自此,Gradio 得以与 Hugging Face 的模型库、数据集平台和应用市场深度结合,形成了一个更加完善的生态系统。这一举措不仅提升了 Gradio 的可见度,也让它成为了“AI 即服务”理念的重要载体。

Gradio 发展历程

初始发布:模型可视化的第一步(2019)

Gradio 的故事开始于 2019 年,当时两位斯坦福大学的研究者 Abubakar Abid 和 Dawood Khan 意识到,在实验过程中,频繁需要将训练好的模型打包成界面,便于展示、调试和他人使用。传统方法需要用 Flask 或 React 编写复杂的后端和前端代码,而他们的愿景是:“为何不能只用几行 Python 就构建一个界面?”

于是,一个名为 Gradio 的工具被创建,并以 Apache 2.0 开源协议发布在 GitHub 上。从最初版本起,它便提供了一个极简的 Interface 类,让开发者可以用如下方式快速构建交互界面:

import gradio as gr

def greet(name):

return f"你好,{name}!"

gr.Interface(fn=greet, inputs="text", outputs="text").launch()

这一简单例子成为无数初学者和研究人员了解 Gradio 的“Hello World”。

初期版本支持的功能虽然有限,但由于其极低的学习成本与部署门槛,迅速在高校、开源竞赛和研究团队中流行开来。

核心理念明确:专注“低门槛、高交互性”

与 Dash 或 Streamlit 相比,Gradio 并没有意图成为一个全面的 Web 应用开发框架。它更加聚焦于“为机器学习模型构建交互界面”这一细分场景。

Gradio 在 GitHub 和社区论坛上的快速传播,证明了这一细分定位的广泛需求。这种聚焦策略也推动了开发团队围绕“交互性”持续优化产品体验,例如:

- 提供预览图形界面、可一键共享的在线链接;

- 支持语音、图像、视频等输入;

- 内置示例和错误提示机制,提升开发效率;

- 兼容 Jupyter Notebook 与 Colab 环境。

这些特性让 Gradio 成为了教学、演示和科研论文原型的理想选择。

被 Hugging Face 收购:进入主流 AI 生态(2021)

2021 年,Gradio 被 Hugging Face 收购,成为其产品矩阵中的重要一环。这一事件是 Gradio 发展历程中的重大转折点,影响深远:

- 资源整合:Gradio 获得了来自 Hugging Face 的资金与工程资源支持,加快了产品演进速度。

- 生态融合:它与 Hugging Face Hub 实现无缝集成,用户可以直接通过 Gradio 调用 Transformer 模型、数据集、Spaces 应用等服务。

- 影响力扩展:借助 Hugging Face 社区的全球影响力,Gradio 的用户基础迅速扩张到企业开发者、AI 初创团队和国际研究机构。

从此,Gradio 不再只是一个工具,而成为 Hugging Face 推动“AI 体验普及化”的关键基础设施。

功能拓展:从 Interface 到 Blocks 再到 Gradio Lite

Gradio 在被收购后进入快速迭代期,产品形态也经历了几个关键阶段:

| 阶段 | 核心特征 |

|---|---|

| Interface 模式 | 最初版本,适合单一函数或模型接口的展示,语法简洁,适合初学者。 |

| Blocks API | 引入模块化编程理念,支持多个组件组合与事件绑定,可构建更复杂的交互逻辑和布局结构。 |

| Gradio Lite | 适用于 HTML 中嵌入 Gradio 应用的轻量版本,支持无服务器运行、无需 Python 后端。 |

这一演化路径充分体现了 Gradio 的技术适应能力:它既保持了上手门槛低的优势,又持续向更复杂的交互需求靠拢,逐步成为开发原型、构建前端乃至无服务器部署的多面手。

社区推动力:Gradio 成功的底层引擎

Gradio 的成功,其活跃的开源社区是不可忽视的重要因素:

- 每个新版本都配备详实的文档和教程;

- 官方提供了丰富的组件库和预训练模型展示;

- Hugging Face Spaces 平台上已聚集数千个 Gradio 应用示例,供开发者参考;

- Gradio 被广泛用于 NeurIPS、ICML 等顶级 AI 学术会议的演示作品中。

这种“技术+内容+社区”的生态闭环,使得 Gradio 的迭代速度与落地场景不断丰富,形成良性循环。

当前定位:从工具走向平台

如今的 Gradio,已经不再只是一个“搭建交互界面的小工具”。它是:

- Hugging Face 推动 AI 开源生态的关键入口;

- 开发者构建、演示、测试模型的一站式平台;

- 教育、科研、企业都在广泛采用的生产级工具。

这种从“工具”到“平台”的转变,不仅提高了其战略价值,也表明了一个趋势:在 AI 进入“用起来”的阶段,工具的交互体验正在成为决定价值的重要标准。

Gradio 核心功能

Gradio 的核心竞争力,来自其“以最小代价实现最大交互”的设计哲学。它将传统 Web 开发中复杂的前端组件抽象为一组统一的输入/输出接口,使得即便是没有 Web 编程经验的开发者,也能轻松构建可视化模型界面。

输入输出组件的丰富性与直觉性

Gradio 的基础单位是“组件(Component)”。所有模型的输入与输出,都是通过这些组件进行结构化封装的。组件涵盖了常见的数据类型,并支持必要的交互能力,例如输入验证、界面占位提示、动态更新等。

以下是 Gradio 常用组件分类及功能对照表:

| 类型 | 常用组件 | 功能描述 |

|---|---|---|

| 文本类 | Textbox, TextArea |

接收用户输入或展示文本结果,支持单行、多行等形式 |

| 图像类 | Image |

接收上传图片或展示模型生成/处理结果 |

| 音频类 | Audio |

接收录音或播放模型生成的音频 |

| 视频类 | Video |

支持上传短视频或展示视频生成结果 |

| 数据类 | Dataframe, JSON |

支持结构化数据的展示与操作 |

| 控件类 | Slider, Checkbox, Dropdown, Radio |

提供交互控件,用于控制模型参数或模式选择 |

| 输出类 | Label, Highlight, Gallery |

展示模型输出结果的可视化形式 |

这些组件几乎可以满足目前主流 AI 应用中的所有输入输出需求,从图像识别、文本生成,到语音合成、视频理解等任务,都可以借助这些组件灵活配置界面。

快速构建与部署的极简流程

Gradio 的开发流程非常直观,核心步骤通常包括:

- 定义业务函数(如模型推理函数);

- 选择合适的输入输出组件;

- 使用

Interface或Blocks构建界面; - 调用

.launch()启动应用。

示例代码:

import gradio as gr

def classify(image):

return "狗" if "dog" in image.filename else "猫"

gr.Interface(fn=classify, inputs=gr.Image(), outputs="text").launch()

该代码几乎没有复杂结构,却能够立即在浏览器中呈现一个上传图像并进行分类的 AI 应用。这种极简能力,尤其适合教学、竞赛、原型设计等需要快速迭代的场景。

Gradio 的部署支持:

- 本地运行;

- 生成公开链接供他人访问;

- 自动部署到 Hugging Face Spaces 上(支持公开和私有项目);

- 使用 Gradio Lite 直接嵌入网页。

这种“从构建到部署只需一行代码”的设计,大幅降低了模型服务的技术门槛。

Blocks API:模块化构建复杂界面的能力

虽然 Interface 模式足够满足 80% 的使用需求,但当需要构建更复杂的页面布局和交互逻辑时,Blocks API 提供了更强大的灵活性。

通过 Blocks,开发者可以:

- 嵌套组件,控制布局;

- 使用

on_click,on_change等事件机制绑定交互; - 多输入多输出处理;

- 创建多页面、多状态的 Web 应用。

示例代码片段展示了如何使用 Blocks 设计图像上传 + 参数调节 + 图像生成流程:

with gr.Blocks() as demo:

with gr.Row():

image_input = gr.Image()

prompt = gr.Textbox(label="输入提示词")

with gr.Row():

generate_button = gr.Button("生成")

output = gr.Image()

generate_button.click(fn=generate_fn, inputs=[image_input, prompt], outputs=output)

这种高度可控的界面逻辑,使得 Gradio 不再局限于演示级应用,而是具备了构建商业级原型或用户测试平台的能力。

热重载与开发体验优化

Gradio 提供了热重载(gradio.live())和日志跟踪等机制,极大地优化了开发者体验:

- 修改 Python 脚本后,无需重启服务器即可看到界面更新;

- 控制台实时输出用户请求与模型响应,方便调试;

- 可设置最大请求并发量,避免服务被滥用。

这些“开发者友好”特性,让 Gradio 成为许多研究者在论文原型阶段的首选工具。

多种部署模式,灵活适配不同场景

Gradio 针对不同的部署需求提供了多样化的方式:

| 部署方式 | 特点 |

|---|---|

| 本地运行 | 适用于测试或教学场景,浏览器访问 localhost 端口即可 |

| 网络共享链接 | 使用 share=True 生成临时公共链接,便于远程展示或协作 |

| Hugging Face Spaces | 一键部署到 Spaces,支持公开、私有项目和团队协作,具备版本控制与访问权限功能 |

| Gradio Lite | 将 Gradio 应用打包为纯前端 HTML,可直接嵌入网站或博客,无需服务器 |

这些多样部署策略,使得 Gradio 不仅适合个人开发者,也能满足企业、教育机构、开源社区的多层级使用需求。

与第三方框架的良好兼容性

Gradio 支持与多种主流机器学习框架无缝集成:

- 支持 PyTorch、TensorFlow、scikit-learn、XGBoost 等;

- 可搭配 OpenCV、PIL、NumPy 等图像/音频处理工具;

- 与 Hugging Face Transformers 深度融合,一行代码调用 BERT、Whisper 等模型;

- 可与 LangChain、LlamaIndex 等大语言模型框架联合构建 AI 应用。

这种框架中立的设计,极大增强了 Gradio 的适应能力与生态兼容性。

Gradio 技术架构

Gradio 之所以能用简单的 Python 代码实现复杂的 Web 界面,背后依赖的是其模块化的前后端分离架构与轻量化的运行机制。它在技术选型和架构设计上展现出非常强的平衡感:既保持了低耦合、高通用性,又兼顾了速度与易用性。

整体来看,Gradio 的系统架构可划分为以下几个关键层次:

- Python 后端:业务逻辑处理与模型调用;

- 中间数据交换层:通过 JSON 序列化进行输入/输出通信;

- 前端展示层:浏览器端渲染 UI 界面并接收用户交互;

- 部署与运行容器:决定应用是本地运行、远程链接、还是托管于云平台。

后端:Python 驱动的数据处理核心

Gradio 的后端是其最核心的模块,由纯 Python 实现,兼容 CPython 和多数 Python 运行环境(如 Anaconda、Conda、Virtualenv 等),并支持以下特性:

- 使用 Flask 或 FastAPI 的简易封装,提供 HTTP 接口;

- 接收前端发送的用户输入数据,执行模型预测函数;

- 将预测结果打包成 JSON 返回前端;

- 支持异步调用、队列限制、错误处理等机制。

Gradio 并不强制绑定任何机器学习框架。它对用户函数的要求非常宽泛:只要是一个可调用的 Python 函数,就可以作为模型入口。这意味着无论你是调用 Hugging Face 的语言模型,还是本地训练的 scikit-learn 分类器,都可以原样接入 Gradio 界面。

函数封装机制

每个被绑定到组件的 Python 函数,都会被封装为一个服务实例。在输入组件提交数据后,Gradio 会自动将数据类型转换为函数可接受的格式(例如将 base64 图像转换为 PIL 对象),并在函数执行完毕后将返回结果转换为前端可识别的格式(如字符串、图像路径等)。

这一机制为非前端开发者消除了大量低层逻辑的负担,极大提升了效率。

前端:浏览器中的可交互 Web UI

Gradio 的前端是基于 React 和 Tailwind CSS 构建的响应式 SPA(单页应用),采用了现代化的前端开发理念。它主要实现以下功能:

- 渲染输入/输出组件的布局与样式;

- 响应用户的操作并触发事件(如按钮点击、数据上传);

- 向后端发送 HTTP 请求(通常是 POST/PUT),携带输入内容;

- 接收后端的 JSON 响应并更新 UI 展示结果。

前端通过组件 ID 实现与后端的数据绑定,不依赖页面刷新即可实现页面状态更新。这种前后端分离架构确保了高扩展性,也便于未来升级前端表现力而不影响后端逻辑。

通信机制:JSON 数据交换与 Session 管理

Gradio 使用标准的 REST 风格 API 接口来实现前后端通信。所有数据都以 JSON 格式进行序列化与传输:

- 输入数据由组件生成并封装为标准结构;

- 请求携带组件 ID、Session ID 以及输入内容;

- 后端解析后调用业务逻辑函数处理;

- 返回结果经过统一处理后返回前端渲染。

此外,Gradio 使用 WebSocket 保持热重载功能,并能追踪每一次调用的 Session,便于调试和多用户访问。

部署方式的架构实现

Gradio 支持以下几种部署场景,其底层运行方式虽不同,但统一使用 Python 后端与 Web 前端协同运行:

| 部署模式 | 底层机制 | 说明 |

|---|---|---|

| 本地模式 | Python 启动本地 Flask 服务,监听端口 | 默认 localhost:7860,适合开发与测试使用 |

网络共享(share=True) |

通过 Gradio 提供的中转服务转发请求 | 生成公开链接供远程访问,链接有效期有限 |

| Hugging Face Spaces | 使用 Docker 容器运行应用,自动托管与版本管理 | 部署在 Hugging Face 云平台上,支持自定义依赖和私有访问 |

| Gradio Lite | 将组件渲染逻辑编译为 HTML 和 JS,无需服务器,纯前端部署 | 适用于静态网页、博客嵌入场景 |

这种灵活的部署架构设计,保证了 Gradio 可以覆盖从实验室、笔记本,到线上演示平台的完整使用周期。

与外部资源的集成能力

Gradio 并不局限于本地资源,它天然支持以下外部资源集成:

- 与 Hugging Face Hub 的深度绑定:一键调用模型、数据集、Spaces;

- 可通过

gr.load()加载已托管模型或接口(包括 API 端点); - 支持集成数据库、云存储(如 S3、Google Drive)作为数据输入源;

- 允许与 JavaScript 自定义脚本联动,拓展组件行为。

这使得 Gradio 不仅仅是一个“前端生成工具”,更是一个能嵌入各种机器学习系统的接口适配层。

安全性与隔离性设计

在安全方面,Gradio 提供了一些基本机制用于保护部署内容和用户输入数据:

- 支持密码保护和权限限制;

- 自动清除临时文件;

- 在 Hugging Face Spaces 上可配置私有项目;

- 对每一次交互做输入类型验证与异常处理;

- 默认禁用浏览器缓存执行上下文,保护模型私有逻辑。

虽然 Gradio 目前并非为大规模线上生产系统而设计(如无 API 限流机制、无高并发负载均衡),但它在原型验证与教学演示阶段提供了足够稳健的运行能力。

Gradio 应用场景

Gradio 的强大不仅源自其技术本身,更体现在它能被应用于众多实际场景之中。它为模型开发、验证、展示和用户交互等多个环节提供了简单但强大的解决方案。因此,从研究机构到创业团队,从开发者到产品经理,Gradio 都成为构建 AI 应用交互界面的首选工具之一。

研究人员与学术场景:高效构建可复现实验演示

在 AI 研究中,模型的可解释性与演示效果越来越受到重视。Gradio 能让研究人员快速将实验成果“图形化”呈现,便于同行评估与非技术人员理解。

常见应用示例

- 论文中展示模型效果(如 NLP 分词、图像分类);

- 模型对抗样本可视化分析;

- 用户调试参数对结果影响的动态演示。

典型案例

在 NeurIPS、ACL 等国际会议中,许多论文作者使用 Gradio 创建附属演示网页,使得同行可在浏览器中直接测试论文模型。这种即时交互式体验,极大增强了论文的传播力和影响力。

教育培训:让学生“看懂模型怎么想”

传统教学中,机器学习模型往往停留在数学推导和静态结果展示阶段,学生很难真正理解其输入输出行为。Gradio 能通过可视化方式,帮助学生理解模型背后的逻辑。

教学用途典型方式

| 教学模块 | Gradio 应用方式 |

|---|---|

| 文本分类 | 学生输入句子,查看模型预测标签并分析其权重可视化 |

| 图像识别 | 上传不同图像,对比模型输出与真实类别 |

| 参数调试 | 设计滑块或单选控件,观察模型输出随参数变化的动态效果 |

| 数据增强与训练 | 结合输入图像与增强方法,实时展示变换效果及训练反馈结果 |

通过这种“边学边操作”的互动体验,Gradio 让抽象算法变得可感知、可验证。

初创企业与原型开发:加速产品验证流程

对于 AI 初创团队或个人开发者而言,从模型开发到用户测试往往存在巨大鸿沟。Gradio 能在零前端成本下,将算法原型转化为可交互的产品界面,快速验证功能和市场反应。

常见使用模式

- 创建 MVP 原型应用;

- 用于向投资人、客户演示模型产品;

- 收集早期用户反馈与行为数据。

产品经理与用户研究团队:低代码交互原型工具

非技术人员如产品经理、交互设计师常需参与 AI 应用规划,但通常不具备 Web 编程能力。Gradio 提供了一个“语言层交互的可视接口”,让他们得以参与到原型设计中。

支持的典型流程

- 搭建模型交互流程图;

- 模拟不同输入路径下的反馈行为;

- 搭配语义按钮、提示词等,引导用户测试不同功能。

这种“数据+交互+反馈”一体化的可视框架,有效促进了跨职能团队之间的沟通效率。

内容创作者与公众科普场景:AI 可视化交互体验

AI 内容创作者、B 站讲师、知乎博主等在讲解模型时,常希望提供可“玩”的互动小工具,让用户亲自体验 AI 能力。Gradio 正好提供了这一“交互式教程”的理想实现路径。

常见应用形式

- 演示 ChatGPT 类模型的文本补全;

- 生成 AI 艺术图像,用户自选风格与描述;

- 构建“图像风格转换器”或“人脸识别小游戏”。

配合 Gradio Lite,这些应用甚至可以直接嵌入文章或博客网页中,实现边读边玩、边学边试的流畅体验。

企业内部工具:部署轻量级模型服务

在企业中,数据团队常需要将模型结果提供给非技术业务方查询或使用。Gradio 可作为“快速封装”的交互工具,用于内部模型服务部署。

内部部署特点

- 支持权限设置与访问日志跟踪;

- 适用于财务预测、销售分析、文本归类等任务。

Gradio 与 API 网关、容器平台(如 Docker)配合使用后,可形成轻量、可控、可调的 AI 服务系统。

数据标注与众包平台:结合模型半自动标注

Gradio 支持将人机协同纳入数据标注流程,通过半自动方式提升标注效率与一致性。例如:

- 文本分类模型初步标注,人工确认或修改;

- 图像检测模型自动标出边界框,用户微调;

- 音频识别任务中结合模型结果进行校正。

相比传统 Excel 或自建平台,这种基于 Web 的轻量交互标注系统部署更快、训练更灵活。